Was ist Big Data?

Zu den wertvollsten Rohstoffen unserer Zeit gehören zweifelsohne Daten. In nur 10 Minuten werden heutzutage mehr Daten gesammelt, als in der gesamten Menschheitsgeschichte jemals zuvor. Durchgehend werden Daten erhoben und müssen entsprechend verarbeitet werden. Das Verfahren der Datensammlung und -verarbeitung von großen Menge unstrukturierter Rohdaten, nennt man Big Data. Um Big Data richtig anwenden zu können, muss man sich einmal mit dessen Dimensionen auseinandersetzen.

Die Definition von Big Data

Big Data ist ein Begriff, der in der Wirtschaft, der IT-Branche und im Marketing immer wieder vorkommt. Zur Bedeutung von Big Data findet man verschiedene Erklärungen und Definitionen. Im Wesentlichen werden dabei zwei Aspekte in einem Begriff zusammengefasst. Das sind zum einen die immer stärker anwachsenden Datenbergeund zum anderen die entsprechenden IT-Lösungen und Systeme, die dazu benötigt werden, um mit der Datenflut zu Recht zu kommen und diese produktiv zu verarbeiten. Big Data ist sozusagen die große Kunst, um mit der riesigen Flut von Massendaten umzugehen und diese im wirtschaftlichen, gesellschaftlichen und auch politischen Bereich sinnvoll zu nutzen. Big Data beinhaltet also alle Maßnahmen, die es ermöglichen, große Mengen an Daten zu erheben, zu verarbeiten und diese analytisch zu verwerten.

Dimensionen von Big Data

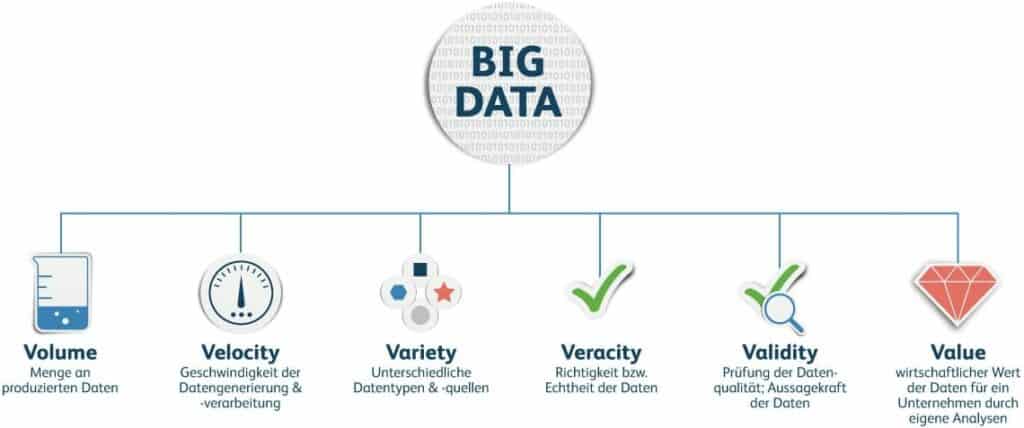

Big Data hat verschiedenen Dimensionen, die so genannten sechs V’s. Dazu gehören: Die Menge der Daten (Volume), die Schnelligkeit der Datenübertragung (velocity), die Analyse und der Umgang mit den Datentypen, also welche Informationen vorhanden sind und woher sie stammen (variety) und die Echtheit, ob die verwendete Daten auch tatsächlich richtig sind bzw. richtig erhoben wurden (Veracity). Hinzu kommen noch zwei weitere Dimensionen, die sich speziell auf die Unternehmensebene beziehen. Validity (Die Qualität der Daten) beurteilt wie gut die gelieferten Daten sind oder was sie aussagen. Anschließend folgt Value, der individuell eingeschätzte Analysewert der Daten für das Unternehmen.

In der folgenden Abbildung habe ich die Dimensionen kurz zusammengefasst:

Einsatzgebiete von Big Data

Die Unternehmen von heute können mithilfe immer neuer Analysewerkzeuge neue Geschäftsmodelle, Produkte und Services entwickeln, um damit ganz neue Märkte zu eröffnen. Neue Entwicklungen und Trends können vorhergesagt und erkannt und daraus neue Handlungsempfehlungen entwickelt werden. Neue Verhaltensmuster können zeitnah erkannt und den Kunden so genau die Produkte präsentiert werden, die sie aktuell gerade benötigen.

In dem Zusammenhang rückt der Begriff Data Warehouse in den Fokus, da diese Information in einer Datenbank namens Data Warehouse zusammengefasst werden. Somit können sie in verschiedenen Dimensionen dargestellt werden. Big Data ermöglicht es, Zielgruppen klar und schnell zu erkennen und deren Wünsche, Bedürfnisse und Absichten zu erahnen, was zu einem klaren Wettbewerbsvorteil führen kann. Deshalb sammeln Unternehmen zunehmend mehr Daten von Geschäftspartnern, Lieferanten, ganzen Märkten und insbesondere von ihren Kunden.

Nahezu unüberschaubare Datenquellen

Big Data beinhaltet eine nahezu unüberschaubare Flut von strukturierten und unstrukturierten Daten. Diese Informationen stammen aus den vielfältigen Quellen der zunehmenden Vernetzung und (mobilen) Internetnutzung. ERP- und CRM-Systeme liefern eine Vielzahl von Informationen beim Onlineshopping, durch Serviceanfragen bei Dienstleistern und Händlern und vielem mehr. Daneben sind Social Media Plattformen die zweite wichtige Datenquelle.

Alle nur denkbaren Aktivitäten im Netz liefern durchgehend Informationen zu Personen, deren Bedürfnissen und deren Umfeld. Darüber hinaus liefern Sensoren und RFID Chips, Suchanfragen und Webseitenaufrufe, Logdaten von IT-Systemen und M2M (Machine-to-Machine-Kommunikation) weitere Daten, die allesamt gesammelt und analysiert werden und letztendlich dazu dienen, exakt auf den Nutzer zugeschnittene und ganz individuelle Angebote zu entwickeln.

Schon längst sind Analyse und Verarbeitung der ständig wachsenden Datenflut nicht nur für die großen Unternehmen von großem Interesse. Stattdessen haben auch mittelständische und kleine Unternehmen längst die gewinnbringenden Chancen der Datenverarbeitung für sich erkannt und sind daran interessiert Big Data zu nutzen.

Zwar kann die stark anwachsende Datenmenge durch immer größer werdende Rechner und Datenspeicher immer besser erfasst und ausgewertet werden, doch die Anschaffung derartiger Systeme kommt für viele Unternehmen nicht in Betracht. Hier kommen Cloud Hosting Anbieter in Frage, die auch kleinen und mittelständischen Unternehmen eine virtualisierte Infrastruktur zur Verfügung stellen, mit der auch diese Big Data kostengünstig nutzen können.

Zuverlässige Datenquellen finden

Heutzutage ist es eine große Herausforderung an qualitativ hochwertige Daten heranzukommen. Eine einfache Google-Suche reicht nicht immer aus, wenn man qualitativ hochwertige Daten benötigt. Daher spielen hier Datenbankhosts eine große Rolle. Die Daten sind eine großer Überbegriff mit vielen untergeordneten Datentypen. Da muss es dir besonders klar sein, welche Art der Informationen du brauchst und wo du diese erhalten kannst.

Im Folgenden Tabelle lernst du ein Paar wichtige Datenbankhosts kennen, die qualitative Daten zur Verfügung stellen:

| Art der Informationen | Kostenlos | Kostenpflichtig |

|---|---|---|

| Personeninformation | eigene Webseite, Facebook, LinkedIn, Twitter, Munzinger Archiv, Zeitung (Rubrik der Personalien) | GBI Genios (ManagerDossiers) für deutschsprachigen Raum, LexisNexis (Library People) auch für englischsprachigen Raum besonders USA |

| Unternehmensinformation | Unternehmens-Webseite, Zeitung, Bundesanzeiger | GBI Genios, LexisNexis, Bureau van Dijk, FACTIVA, ProQuest |

| Brancheninformation | Wirtschaftsinstitute, Branchenbriefe der Berliner Volksbank | GBI Genios, ProQuest, FACTIVA |

| Produktinformation | Produktkatalog, auf verschieden Messen, auf Homepage verschiedene Vereine | ProQuest |

Fazit

Wie bereits erwähnt, ist Big Data ein Sammelbegriff für viele interessante Teilbereiche: Deep Learning wird beispielsweise auf Big Data zum Analysezweck angewendet. Die Datenquellen von Big Data sind oft Not only SQL (NoSQL)-Datenbanken, die sowohl SQL, als auch nicht SQL-Datentypen beinhalten. Data Warehouses als weiterer Bestandteil von Big Data stellen eine zentrale Datenbank dar, die langfristig die vorhandenen Daten in verschiedenen Datenbeständen vorhält und vorbereitet.